Google mette il turbo alla sua Intelligenza Artificiale e potenzia non solo Google Lens ma rilascia anche la ”Ricerca Multipla” che permette di ottenere suggerimenti su scansioni di prodotti tramite la sola foto. Novità anche per Google Maps e per Google Traduzione. Ecco tutto quello che dovete sapere.

Google Lens ancora più potente e grande

Partiamo da Google Lens ossia quella funzionalità che conosciamo bene e che permette tramite la fotocamera dello smartphone di catturare un’immagine di qualsiasi oggetto e di ottenere automaticamente (e anche velocemente) tutte le informazioni che lo riguardano. ”I prodotti che realizziamo in Google hanno un unico, straordinario obiettivo: essere il più possibile utili alle persone, in qualsiasi momento. E da sempre siamo convinti che l’intelligenza artificiale possa potenziare il modo in cui raggiungiamo questo obiettivo” queste le parole di Elizabeth Reid, Vice President & GM, Search che riassumo senza alcun dubbio le volontà di Google in questo campo.

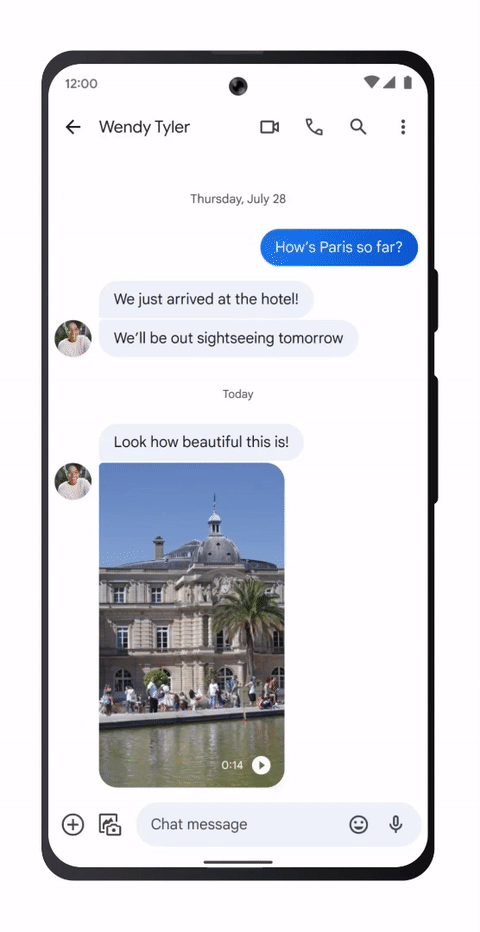

Google Lens è senza dubbio uno strumento molto utilizzato dagli utenti perché in qualche modo non fa altro che darci risposta su ciò che effettivamente guardiamo in giro e possiamo dunque riprendere con le fotocamere del nostro smartphone. Pensate che secondo i dati di Google, Lens viene usato oltre 10 milardi di volte al mese. In questo caso si accede a G Lens dalla barra delle ricerche ma il cambiamento che sta per arrivare riguarda la possibilità di usare Lens con la funzione “Search your screen” su Android in tutto il mondo. Con questa tecnologia, sarà possibile cercare davvero ciò che vedete in una foto o in un video sul web e nelle app preferite, come le app di messaggistica e video, senza dover uscire dall’app o dall’esperienza specifica.

Ad esempio se qualche vostro contatto vi invia un messaggio con un video in cui visita la città di Parigi. Se volete saperne di più sul monumento sullo sfondo potete semplicemente toccare e tenere premuto il pulsante di accensione o il pulsante Home sul vostro telefono Android (che richiama l’Assistente Google) e quindi toccare ”search screen”. Lens lo identifica come Palazzo del Lussemburgo e voi potete cliccare per saperne di più.

La Ricerca Multipla è la ricerca nella ricerca!

Novità assoluta già attiva da oggi anche in Italia è invece la Ricerca Multipla ossia la possibilità di avere informazioni partendo da un’immagine o un testo e allo stesso tempo interagendo più e più volte con i risultati e permettendo dunque all’utente di avere nuove forme di conoscenze ma anche esperienze di approfondimento. Come funziona? Semplice! Basterà aprire Google Lens e scansionare quello che si vuole, ad esempio una camicia bianca. L’algoritmo velocemente cercherà sul web quello che riconosce dall’immagine scattata in presa diretta e proporrà tutte le informazioni su quella camicia ripresa. A questo punto però tappando su ”Aggiungi alla tua ricerca” sarà possibile interagire su quelle informazioni magari chiedendo se c’è di colore rosso o verde o se c’è a manica corta o lunga e automaticamente Google vi fornirà ulteriori risultati di ricerca.

.gif)

E c’è di più perché la Ricerca multipla aggiungerà anche la possibilità di cercare vicino a voi. Potrete infatti scattare una foto e aggiungere “vicino a me” per trovare ciò di cui avete bisogno, che stiate cercando di supportare le attività commerciali di quartiere o semplicemente che abbiate bisogno di trovare qualcosa in fretta. Attualmente è disponibile in inglese negli Stati Uniti e nei prossimi mesi la estenderemo a livello globale. Oltretutto nei prossimi mesi, la Ricerca multipla sarà presente su qualsiasi immagine visualizzata nella pagina dei risultati di ricerca sui dispositivi mobili.

.gif)

Google Maps: sempre più ”immersiva”

Novità anche per Google Maps e la sua visione del tracciato a piedi e non solo. La novità assoluta è l’arrivo per alcune città europee della visualizzazione immersiva come modo completamente nuovo di esplorare un luogo. In questo caso la nuova modalità permetterà di far sentire l’utente come se stesse davvero nel luogo che sta cercando da web o da mobile ancora prima di visitarlo fisicamente. Qui c’è di mezzo la potenza dell’intelligenza artificiale e della computer vision, la visualizzazione immersiva fonde miliardi di immagini di Street View e immagini aeree per creare un modello digitale del mondo incredibilmente ricco. E sovrappone informazioni utili come il tempo, il traffico e quanto è affollato un luogo.

L’idea è quella di organizzare al meglio e nello specifico il vostro viaggio. Supponiamo che stiate programmando una visita al Rijksmuseum di Amsterdam. Potete sorvolare virtualmente l’edificio e vedere dove si trovano, ad esempio, gli ingressi del museo. Con il dispositivo di scorrimento temporale, potete vedere come appare l’area nelle diverse ore del giorno e che tempo farà. Potrete anche individuare i luoghi più affollati, in modo da avere tutte le informazioni necessarie per decidere dove e quando andare. Se avete fame, scendete al livello strada per esplorare i ristoranti vicini, e date anche un’occhiata all’interno per capire rapidamente l’atmosfera di un locale prima di prenotare.

Tecnicamente per creare tutto ciò, Google ha utilizzato i campi di radianza neurale (NeRF), una tecnica avanzata di intelligenza artificiale che trasforma le immagini ordinarie in rappresentazioni 3D. Con NeRF, è stato possibile ricreare con precisione l’intero contesto di un luogo, compresa l’illuminazione, la consistenza dei materiali e lo sfondo. Tutto ciò permette di capire se l’illuminazione lunatica di un bar è l’atmosfera giusta per una serata galante o se la vista di un caffè lo rende il luogo ideale per un pranzo con gli amici.

E poi c’è anche la ricerca con Live View: in questo caso si utilizza l’intelligenza artificiale e la realtà aumentata per aiutare gli utenti a trovare le cose che li circondano, come bancomat, ristoranti, parchi e stazioni di transito, semplicemente mettendo il telefono in posizione verticale mentre si è in strada. Recentemente la ricerca con Live View è stata rilasciata a Londra, Los Angeles, New York, Parigi, San Francisco e Tokyo. Nei prossimi mesi verrà estesa anche a Barcellona, Dublino e Madrid.

A Google piacciono anche i veicoli elettrici e per questo ha pensato di rendere più facile la guida con un veicolo del genere. Ecco allora l’introduzione di nuove funzionalità per i conducenti di veicoli elettricicon Google Maps integrato:

- ️Più punti di ricarica per i viaggi più brevi: per qualsiasi viaggio che richieda una sosta di ricarica, Maps suggerirà il punto migliore in base a fattori quali il traffico in quel momento, il livello di carica e il consumo di energia previsto. Una preoccupazione in meno, indipendentemente da dove siete diretti. E se non volete sostare in quel punto, bastano pochi tap per passare al successivo.

- Stazioni di ricarica molto veloci: Il filtro di ricarica “molto veloce” vi aiuterà a trovare facilmente le stazioni con caricatori da 150 kilowatt o superiori. Per molte autovetture, ciò consente di avere energia sufficiente per fare il pieno e tornare in strada in meno di 40 minuti.

- Stazioni di ricarica nei risultati della ricerca: Vi mostreremo anche nei risultati di ricerca quando luoghi come un supermercato hanno stazioni di ricarica in loco. Così, se state andando a fare la spesa, potrete scegliere più facilmente un negozio che vi permetta anche di ricaricare l’auto.

Google Traduttore contestualizzerà le traduzioni

Quando si parla di Intelligenza Artificiale è logico anche parlare di Google Traduttore. I passi da gigante fatti da questa applicazione sono stati davvero importanti ma l’azienda di Mountain View sembra non fermarsi alla semplice traduzione didattica ma vuole portare ad un livello superiore il tutto e per farlo vuole ”contestualizzare” le traduzioni. Cosa significa? Nelle prossime settimane Google offrirà più opzioni di traduzione contestuale con descrizioni e vari esempi nella lingua di partenza e di con quella tradotta. Questo permetterà di scegliere i termini giusti in base alla situazione e alle intenzioni, e dare una sfumatura più giusta a ciò che si vuole scrivere o dire evitando di parlare come un robot. Purtroppo al momento non ci sarà l’italiano ma si parla di inglese, francese, tedesco, giapponese e spagnolo.

Oltretutto sappiate che il nuovo design di Google Traduttore, da poco introdotto su Android con più spazio per digitare e un’organizzazione più chiara delle fonti da cui tradurre, sarà presto implementato anche in iOS. Basterà scegliere una lingua o visualizzare le traduzioni recenti con uno swipe verso il basso. Le traduzioni saranno più leggibili grazie a un font dinamico che regola le dimensioni in base alla lunghezza.

Precedente

Intelligenza artificiale, Google vs OpenAiSuccessivo

Shopping su whatsapp è possibileArticoli recenti

- AI Privacy-First per le Imprese: come proteggere i dati e creare vantaggio competitivo

- Operator, il nuovo servizio di OpenAi

- ChatGPT avvia il Search. Diremo addio a Google?

- L’intelligenza artificiale può semplificare le interazioni digitali, le vendite, l’assistenza ai clienti e le prenotazioni

- Turismo 4.0: Il Progetto Tourism Digital Hub del Ministero del Turismo